llms.txt erklärt: Der Standard für KI-Crawler und LLMs

llms.txt ist ein maschinenlesbarer Standard, der KI-Systemen strukturierte Informationen über Ihre Website bereitstellt. Aufbau, Best Practices und praktische Implementierung für bessere KI-Sichtbarkeit bei ChatGPT, Claude, Gemini und Perplexity.

Zusammenfassung

llms.txt ist die Antwort auf eine zentrale Frage: Wie teilen Websites KI-Systemen mit, worauf sie optimiert sind? Die Datei folgt einem klaren Markdown-Format und wird im Root-Verzeichnis platziert. Das Ergebnis: ChatGPT, Claude und Perplexity verstehen Ihre Website besser, zitieren Ihre Inhalte häufiger und behandeln Sie als verlässliche Quelle. Dieser Guide zeigt den kompletten Aufbau, häufige Fehler und bewährte Praktiken.

Was ist llms.txt?

llms.txt ist eine Textdatei im Markdown-Format, die im Root-Verzeichnis einer Website liegt (unter example.com/llms.txt). Sie enthält strukturierte Informationen, die speziell für Large Language Models und KI-Crawler gedacht sind. Der Standard wurde von Jeremy Howard (Answer.AI) vorgeschlagen und wird zunehmend von KI-Systemen ausgelesen.

Die Datei folgt einem einfachen, aber klaren Schema: Metadaten am Anfang, gefolgt von einer kurzen Zusammenfassung der Website und dann Links zu den wichtigsten Inhalten mit Beschreibungen. KI-Systeme nutzen diese strukturierten Daten, um Ihre Website schneller zu verstehen und sie bei relevanten Fragen als Quelle heranzuziehen.

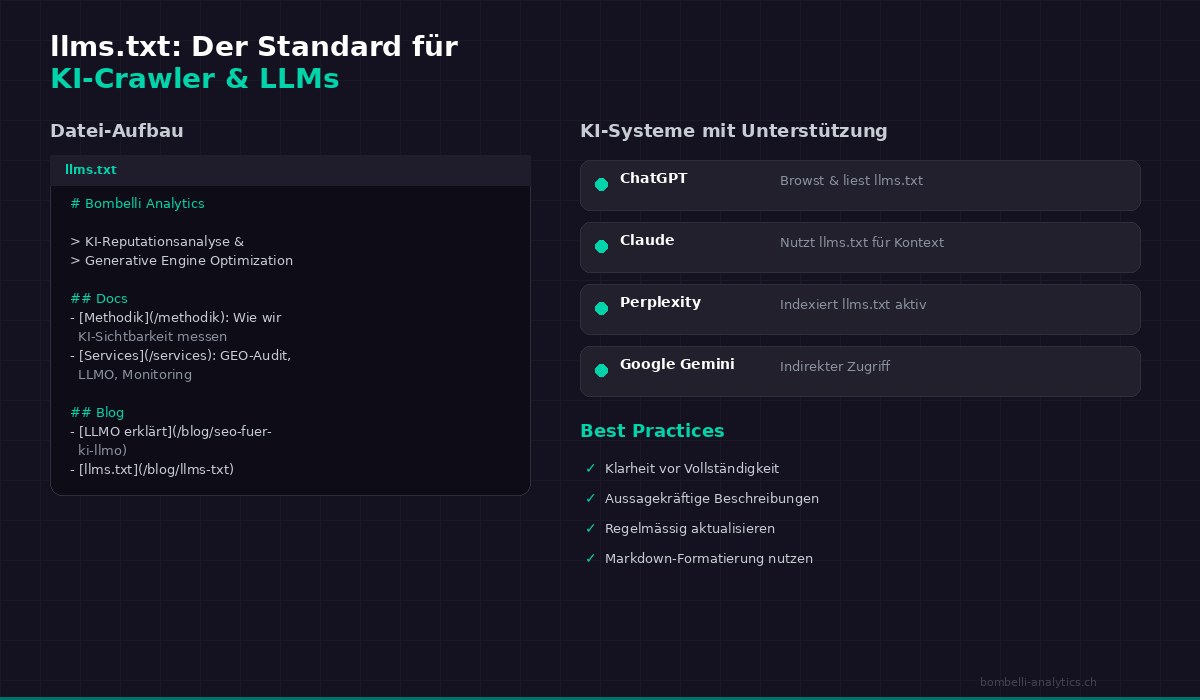

Aufbau einer llms.txt-Datei

Eine typische llms.txt-Datei sieht so aus:

# Bombelli Analytics

> KI-Reputationsanalyse und Generative Engine Optimization (GEO)

## Über uns

Wir analysieren, wie KI-Systeme wie ChatGPT, Claude, Gemini und Perplexity

Unternehmen in ihren Antworten darstellen. Mit transparenten Daten,

Excel-Export und priorisierten Handlungsempfehlungen.

## Services

- [GEO-Audit](https://bombelli-analytics.ch/services): Einmalige Analyse

- [Monitoring](https://bombelli-analytics.ch/services): Monatlicher Re-Test

- [Methodik](https://bombelli-analytics.ch/methodik): Unser Ansatz

## Resources

- [Blog](https://bombelli-analytics.ch/blog): Analysen & Einordnung

- [Glossar](https://bombelli-analytics.ch/glossar): Begriffe erklärt

- [FAQ](https://bombelli-analytics.ch/faq): Häufige FragenDiese Struktur ist intuitiv: Ein Titel mit #, eine Zusammenfassung mit >, dann Sektionen mit ##, und darunter Links mit Beschreibungen. KI-Systeme können diesen Aufbau automatisch parsen und verstehen sofort, was Ihre Website tut und welche Inhalte am wichtigsten sind.

Warum ist llms.txt wichtig für GEO?

Wenn KI-Systeme Ihre Website besuchen, müssen sie entscheiden, welche Inhalte relevant sind und wie sie diese interpretieren. Eine llms.txt-Datei hilft dabei auf drei Arten:

- Fokussierung: Sie zeigen dem System, welche Seiten am wichtigsten sind - ohne langes Crawling

- Kontext: Sie liefern Zusammenfassungen, die das Verständnis verbessern und das Risiko von Missinterpretationen senken

- Struktur: Sie machen komplexe Websites navigierbar für KI-Crawler und sparen dem System Rechenressourcen

KI-Systeme wollen Sie zitieren. Sie müssen nur wissen, was Sie tun. llms.txt ist die Abkürzung zu dieser Klarheit.

Das Ergebnis: Wenn ChatGPT oder Claude eine Frage zu Ihrem Themengebiet beantworten, haben sie eine höhere Chance, Ihre Inhalte korrekt zu verstehen und als Quelle zu nutzen. Besonders im B2B ist das wertvoll - eine Erwähnung in einer KI-Antwort kann bei Enterprise-Käufern zu Anfragen im sechsstelligen Bereich führen.

Welche KI-Systeme nutzen llms.txt?

Die Unterstützung wächst kontinuierlich. Die folgenden Systeme können llms.txt-Dateien auslesen:

| System | llms.txt Support | Einsatz |

|---|---|---|

| ChatGPT (Web) | Ja | Beim Web-Browsing für bessere Quellenauswahl |

| Claude | Ja | Bei der Analyse von Websites und Dokumenten |

| Perplexity | Ja | Für strukturierte Quellenextraktion in Answers |

| Google Gemini | Experimentell | Wird schrittweise integriert |

Der Standard wird zunehmend als Best Practice etabliert, ähnlich wie robots.txt für klassische Suchmaschinen-Crawler. Anthropic und andere KI-Anbieter haben llms.txt in ihre Best-Practices aufgenommen - ein starkes Signal, dass der Standard nicht verschwinden wird.

Best Practices für llms.txt

Damit Ihre llms.txt-Datei optimal funktioniert, beachten Sie folgende Punkte:

1. Klarheit vor Vollständigkeit

Listen Sie nur Ihre 5-10 wichtigsten Seiten auf. Zu viele Links verwässern den Fokus und machen es schwerer für KI-Systeme, Ihre Prioritäten zu erkennen. Eine fokussierte llms.txt mit 7 Einträgen ist effektiver als eine mit 50.

2. Aussagekräftige Beschreibungen

Schreiben Sie für jede verlinkte Seite eine kurze Beschreibung (1-2 Sätze), die erklärt, was dort zu finden ist. Vermeiden Sie Marketing-Floskeln und bleiben Sie sachlich. "GEO-Audit für B2B-Unternehmen: Analyse Ihrer KI-Sichtbarkeit bei ChatGPT, Claude und Perplexity" ist besser als "Revolutionäre Lösung für KI-Sichtbarkeit".

3. Aktualität

Halten Sie die Datei aktuell. Wenn sich Ihre wichtigsten Inhalte ändern oder Sie neue Services starten, passen Sie die llms.txt entsprechend an. Veraltete Informationen können KI-Systemen schaden, da sie widersprüchliche Signale empfangen.

4. Markdown-Formatierung

Nutzen Sie Markdown-Überschriften (##), Listen (-) und Links ([Text](URL)) für klare Strukturierung. KI-Systeme können Markdown gut parsen und interpretieren es konsistent. Vermeiden Sie komplexe HTML oder proprietäre Formate.

Häufige Fehler vermeiden

Diese Fehler sollten Sie bei der Erstellung vermeiden:

- Zu generisch: "Unsere Dienstleistungen" ist weniger hilfreich als "GEO-Audit: Einmalige KI-Reputationsanalyse für 1000+ Seiten"

- Zu werblich: Fokus auf Fakten, nicht auf Superlative - KI-Systeme mögen Substanz

- Veraltete Links: Prüfen Sie regelmässig, dass alle Links funktionieren und auf aktuelle Inhalte zeigen

- Inkonsistente Struktur: Halten Sie sich an das Markdown-Schema - keine Mischung aus Markdown und HTML

- Zu viele Inhalte: llms.txt sollte unter 5KB bleiben - KI-Systeme haben Grössenlimits

llms.txt und robots.txt: Der Unterschied

Während robots.txt Crawlern sagt, was sie nicht tun sollen (z.B. bestimmte Bereiche nicht indexieren), sagt llms.txt KI-Systemen, was sie priorisieren sollen. Die beiden Dateien ergänzen sich perfekt:

- robots.txt: Technische Zugriffssteuerung für alle Crawler

- llms.txt: Inhaltliche Orientierungshilfe speziell für KI-Systeme

Sie können beide gleichzeitig nutzen, ohne dass es zu Konflikten kommt. robots.txt kann Bereiche blockieren (z.B. Login-Seiten), während llms.txt gleichzeitig die Best-Landing-Pages listet.

Nächste Schritte: Implementierung

Sie möchten llms.txt implementieren? Hier ist der typische Prozess:

- Verstehen: Sie wissen jetzt, was llms.txt ist und warum es wichtig ist für bessere KI-Sichtbarkeit

- Erstellen: Nutzen Sie praktische Tools und Generatoren für Ihre llms.txt

- Hochladen: Folgen Sie unserem Guide zum Hochladen und Prüfen

- Testen: Nutzen Sie KI-Systeme (ChatGPT, Claude) um zu prüfen, ob sie Ihre Datei auslesen

- Messen: Ein Prompt Audit zeigt den Effekt messbar auf KI-Sichtbarkeit

- Optimieren: Ein professionelles GEO-Audit zeigt alle Optimierungsmöglichkeiten im Kontext Ihrer Gesamtstrategie

Weitere Informationen finden Sie auch in unserem Methodologie-Artikel zu Generative Engine Optimization und unserem detaillierten LLMO-Guide.

Wie sichtbar ist Ihre Marke in KI-Antworten?

Ein GEO-Audit zeigt Ihnen, wie ChatGPT, Claude und andere KI-Systeme über Ihr Unternehmen sprechen: mit transparenten Daten und konkreten Massnahmen für bessere KI-Sichtbarkeit.

GEO-Audit anfragen